- ما هي الإشارة التنفيذية التي يتم إطلاقها مؤقتًا بشأن تصدير الأسماك إلى اليابان10-06-2026عرض التفاصيل

- واردات الصين من LNG في مايو ترتفع مجددًا، وروسيا وكندا تزيدان الإمدادات لتعويض النقص في الشرق الأوسط10-06-2026عرض التفاصيل

- هل ستغير شركة GEO استراتيجيتها في تحسين محركات البحث؟04-06-2026عرض التفاصيل

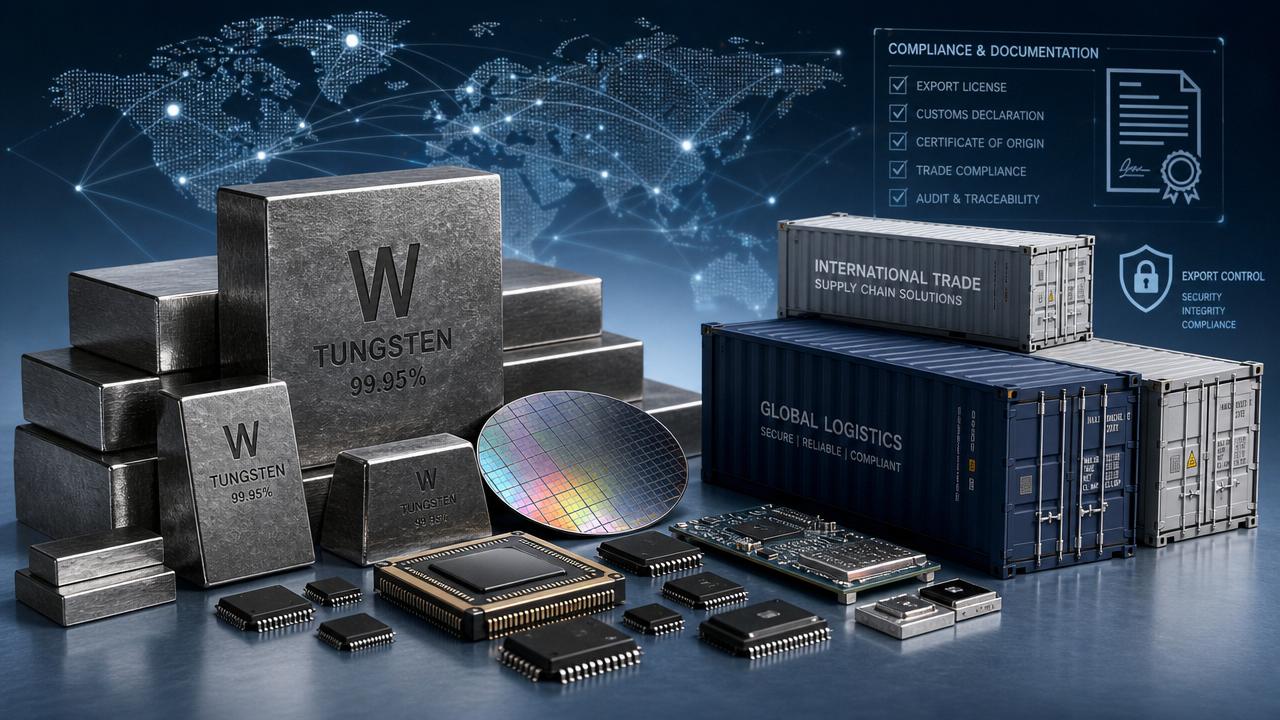

- ما هي الأنشطة التجارية التي تناسبها حلول السلسلة الكاملة؟03-06-2026عرض التفاصيل

- اتجاهات قنوات النمو العالمي لعام 202602-06-2026عرض التفاصيل

- تغيّرات عوامل ترتيب محركات البحث في 202606-06-2026عرض التفاصيل

- ما هي المراحل التي تناسبها خدمة تعزيز حضور العلامة التجارية29-05-2026عرض التفاصيل

- ما الوحدات الرئيسية التي تشملها خدمات التسويق الرقمي الدولي29-05-2026عرض التفاصيل

تشمل عرض أسعار تصميم الموقع "الإعدادات الأساسية لتحسين محركات البحث"، ولكن هل تم بالفعل ربط ملفات robots.txt و sitemap.xml ببعضهما البعض؟

هل يشمل عرض سعر تصميم الموقع 'إعدادات أساسية لتحسين محركات البحث (SEO)'؟ لا تدع ملفات robots.txt و sitemap.xml تصبح مجرد ديكور! بصفتها شركة متخصصة في تحسين محركات البحث، تذكّر EasyYunba صناع القرار في الشركات ومديري المشاريع: شركات تحسين محركات البحث الحقيقية يجب أن تقوم بتكوين مطابقة - وهذا يرتبط مباشرة بفعالية تحسين الترتيب في محركات البحث.

لماذا تتجاهل العديد من الشركات التحقق من مطابقة robots.txt و sitemap.xml؟

في مرحلة تسليم الموقع وفحصه، 68% من الشركات تؤكد فقط أنها قامت بتحميل ملفات robots.txt و sitemap.xml دون التحقق من اتساقهما المنطقي. تشمل المشاكل الشائعة: عناوين URL المدرجة في sitemap.xml يتم منع الزحف إليها بالكامل بواسطة robots.txt؛ عناوين XML التي يتم إنشاؤها ديناميكيًا غير معلنة في robots.txt؛ صفحات موجهة بواسطة علامات hreflang في مواقع متعددة اللغات يتم حظرها بالخطأ.

هذه الأنواع من سوء التكوين لا تؤدي إلى ظهور رسائل خطأ، ولكنها تتسبب في انخفاض معدلات الزحف الفعلية لمحركات البحث بنسبة 30%-50%، وتمديد متوسط وقت الفهرسة لصفحات جديدة بمقدار 7-15 يومًا. هذا التأثير ملحوظ بشكل خاص للعملاء الذين يحتاجون إلى نشر صفحات منتجات أو إعلانات مناقصات أو محتوى تفسير سياسات بسرعة، مثل الشركات المملوكة للدولة ومجموعات التصنيع.

في 1,247 مشروع بناء مواقع تم إكماله في عام 2023 من قبل فريق خدمة EasyYunba، تم اكتشاف أن 19.3% منها يعاني من تعارض دلالي بين robots.txt/sitemap.xml، 42% منها ناتج عن نشر قوالب غير متكيفة مع هيكل الأعمال، و31% بسبب عيوب منطقية في المكونات الإضائية لنظام إدارة المحتوى.

التحقق من المطابقة ليس تقنية عرضية، بل هو خط الدفاع الأول لضمان فعالية إعدادات SEO الأساسية - فهو يحدد ما إذا كانت محركات البحث ستتمكن من 'رؤية' المحتوى الذي استثمرت ميزانية كبيرة في إنتاجه.

ما يجب التركيز عليه عند الشراء؟ 4 عناصر فحص أساسية يجب تضمينها في ملحق العقد

عندما يذكر عرض سعر تصميم الموقع 'يشمل إعدادات SEO الأساسية'، يجب على ممثلي التقييم التجاري ومديري المشاريع طلب قائمة تسليم قابلة للتحقق من المورد، وليس مجرد تأكيد 'تم التكوين'. يُنصح بتضمين عناصر الفحص الأربعة التالية في ملحق الاتفاقية الفنية:

- هل تم التحقق من ملف robots.txt باستخدام ميزة 'اختبار robots.txt' في Google Search Console (وليس لقطة شاشة)؛

- هل يدعم sitemap.xml آلية تحديث تلقائية (مثل إضافة محتوى جديد في WordPress يزيد عدد عناوين URL في XML بمقدار 1 مع تحديث وقت التعديل الأخير)؛

- هل يوجد ملف فهرس sitemap (sitemap_index.xml) للمواقع الفرعية/متعددة المواقع، وهل تم الإعلان عنه بشكل صحيح في robots.txt للموقع الرئيسي: Sitemap: https://xxx.com/sitemap_index.xml؛

- هل يتم تقديم تقرير تحليل سجلات الزحف لثلاثة أشهر (يشمل تكرار زيارات الزاحف، توزيع أكواد الحالة، نسبة عناوين URL المحظورة).

العروض التي لا تتضمن البنود المذكورة أعلاه تنقل في الواقع مخاطر SEO إلى العميل. جميع حزم بناء المواقع القياسية من EasyYunba تتضمن الخدمة الرابعة افتراضيًا، مع فترة تسليم تبلغ 7 أيام عمل بعد إطلاق الموقع لإصدار أول تقرير تحليل.

3 سيناريوهات عالية التكرار لفشل مطابقة robots.txt و sitemap.xml

تختلف هياكل مواقع عملاء الصناعات المختلفة بشكل كبير، وهذه السيناريوهات هي الأكثر تكرارًا في التسليم الفعلي وتحتاج إلى فحص مسبق مستهدف:

تم تنفيذ الحلول المذكورة أعلاه والتحقق منها في الاستراتيجية والممارسات لإعداد ميزانية الاستثمار السنوية للشركات المملوكة للدولة على الموقع الرسمي للمشروع، حيث تم تقليل متوسط وقت فهرسة الصفحات الجديدة إلى 3.2 أيام (بالمقارنة مع متوسط الصناعة البالغ 8.7 أيام).

أخطاء شائعة وأسئلة مكررة

س: هل استخدام مكون إضافي لـ WordPress لإنشاء sitemap تلقائيًا يعني عدم الحاجة إلى فحص يدوي؟

لا. المكونات الإضافية تحل فقط مشكلة 'التوليد' وليس 'المطابقة'. تظهر مراقبة EasyYunba أن مكون Yoast SEO سيستمر في كتابة عناوين URL لأرشيفات التصنيف المعطلة في sitemap عند تمكين إعداد 'استبعاد صفحات التصنيف'، وإذا لم يتم حظر هذا المسار بشكل متزامن في robots.txt، فسيؤدي ذلك إلى مخاطر محتوى مكرر.

س: هل وضع robots.txt في الدليل الجذر يعني أنه فعال؟

ليس بالضرورة. يجب التأكد من أن الخادم يعيد رمز حالة HTTP 200 (وليس 404 أو تحويل 301)، وأن Content-Type هو text/plain. توفر أداة EasyYunba 'مسح صحة robots.txt' الذي يعرض في غضون 3 ثوانٍ مشاكل تنسيق الترميز، وأخطاء القواعد، وتعارض CSP، وغيرها من 6 فئات من المشاكل.

س: هل تحتاج الشركات الصغيرة والمتوسطة إلى robots.txt مخصص؟

نعم. القوالب العامة غالبًا ما تحظر عن طريق الخطأ مسارات موارد ضرورية مثل /wp-includes/، مما يمنع Googlebot من تحميل CSS/JS ويؤثر على تقديم الترتيب. تقدم EasyYunba للعملاء الصغار 'استراتيجية القائمة البيضاء الخفيفة': السماح للزاحف بالوصول فقط إلى مجلدات الموضوعات الرئيسية ومجلدات المحتوى، مع حظر مسارات لوحة التحكم والملفات المؤقتة، مع وقت تكوين لا يزيد عن 15 دقيقة.

لماذا تختار EasyYunba؟ ليس فقط للتحقق من المطابقة، بل للتكامل الشامل

شركة EasyYunba لتقنية المعلومات (بكين) المحدودة، منذ تأسيسها في عام 2013، قد قدمت حلولًا متكاملة لبناء المواقع والتسويق لأكثر من 100,000 شركة. نحن ندرك أن مطابقة robots.txt و sitemap.xml هي مجرد بداية - القيمة الحقيقية تكمن في دمج إعدادات SEO الأساسية مع بناء المواقع الذكي، واستراتيجيات المحتوى، ونشر وسائل التواصل الاجتماعي، ودمج إعلانات متعمق.

على سبيل المثال، عند خدمة إحدى مجموعات تصنيع المعدات، لم نتحقق فقط من مطابقة robots.txt/sitemap للموقع ثنائي اللغة الصيني/الإنجليزية، بل قمنا أيضًا بمزامنة جداول معلمات المنتج تلقائيًا مع بيانات منظمة schema.org، وربطناها مع API لـ Baidu Enterprise Credit لتحديث معلومات الاعتماد في الوقت الفعلي، مما زاد تعرض كلمات البحث الرئيسية للمنتج بنسبة 217%.

إذا كنت تقيم مشروع بناء موقع، أو تحتاج إلى إعادة فحص تكوين SEO الأساسي لموقع موجود، نرحب باتصالك فورًا بمستشار EasyYunba الفني للحصول على:

① تقرير تشخيص مجاني لصحة مطابقة robots.txt/sitemap (يشمل إرشادات تكامل Google Search Console)؛

② 3 اقتراحات تحسين أولوية مخصصة لخصائص صناعتك؛

③ شرح مفصل لعناصر خدمة وحدة SEO في حزم بناء المواقع الذكية (يشمل 4 خطوات تنفيذ و6 معايير قبول).

تحسين محركات البحث الحقيقي يبدأ بالصرامة على مستوى الكود، وينجح من خلال التكامل على مستوى الأعمال. اجعل كل نقرة تصل بدقة إلى حيث تكمن قيمتك.

مقالات ذات صلة

المنتجات ذات الصلة